商机详情 -

重庆H100GPU stock

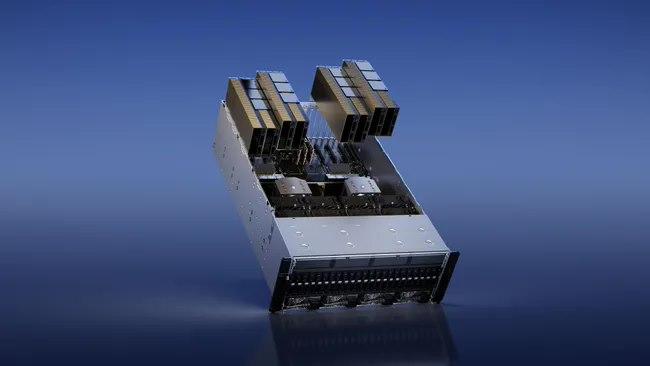

H100 GPU 是英伟达推出的一款高性能图形处理器,旨在满足当今数据密集型计算任务的需求。它采用新的架构,具备强大的计算能力和能效比,能够提升各种计算任务的效率和速度。无论是在人工智能、科学计算还是大数据分析领域,H100 GPU 都能提供良好的性能和可靠性。其并行处理能力和高带宽内存确保了复杂任务的顺利进行,是各类高性能计算应用的良好选择。H100 GPU 拥有先进的散热设计,确保其在长时间高负荷运行时依然能够保持稳定和高效。对于需要长时间运行的大规模计算任务来说,H100 GPU 的可靠性和稳定性尤为重要。它的设计不仅考虑了性能,还兼顾了散热和能效,使其在保持高性能的同时,依然能够节省能源成本。无论是企业级应用还是科学研究,H100 GPU 都能够为用户提供持续的高性能支持。H100 GPU 提供高效的 GPU 直连技术。重庆H100GPU stock

H100 GPU 支持新的 PCIe 4.0 接口,提供了更高的数据传输速度和带宽,与前代 PCIe 3.0 相比,带宽提升了两倍。这使得 H100 GPU 在与主机系统通信时能够更快速地交换数据,减少了 I/O 瓶颈,进一步提升了整体系统性能。PCIe 4.0 的支持使得 H100 GPU 能够与现代主流服务器和工作站更好地兼容,充分发挥其高性能计算能力。H100 GPU 也采用了多项创新技术。其采用了先进的风冷和液冷混合散热设计,能够在高负载运行时保持稳定的温度,确保 GPU 的长期稳定运行华硕H100GPU stockH100 GPU 提供 312 TFLOPS 的 Tensor Core 性能。

H100 GPU 还具备强大的扩展性,支持多 GPU 配置。通过 NVIDIA NVLink 技术,用户可以将多块 H100 GPU 连接在一起,形成一个强大的计算集群。NVLink 提供高带宽、低延迟的 GPU 互连,确保多 GPU 系统中的数据传输高效、稳定。这种扩展性使得 H100 GPU 可以灵活应对不同规模的计算需求,从单节点应用到大规模分布式计算环境,都能够提供出色的性能和效率。在软件支持方面,H100 GPU 配套了 NVIDIA 全的开发工具和软件生态系统。NVIDIA 提供了包括 CUDA Toolkit、cuDNN、TensorRT 等在内的多种开发工具,帮助开发者在 H100 GPU 上快速开发和优化应用。此外,H100 GPU 还支持 NVIDIA 的 NGC(NVIDIA GPU Cloud)容器平台,开发者可以通过 NGC 轻松获取优化的深度学习、机器学习和高性能计算容器,加速开发流程,提升应用性能和部署效率。

我们将定期举办技术交流会和培训,帮助客户更好地了解和使用 H100 GPU 产品。通过与客户的面对面交流,ITMALL.sale 不仅能够分享新的技术和产品信息,还能够深入了解客户的需求和挑战。ITMALL.sale 的技术前辈会在交流会上详细讲解 H100 GPU 的使用方法和最佳实践,解答客户的技术问题,并提供实用的建议和解决方案,帮助客户充分发挥 H100 GPU 的性能,提升业务效率。ITMALL.sale 的技术交流会不仅是客户学习和提升的机会,也是客户与行业前辈交流和合作的平台,促进技术进步和创新发展。H100 GPU 优惠直降,数量有限。

网络、存储、RAM、CPU)以及销售它的人的利润率和支持级别。该范围的**,包括支持在内的$360k-380k,是您可能期望与DGXH100相同规格的。1xHGXH100(PCIe)和8xH100GPU大约是300k美元,包括支持,具体取决于规格。PCIe卡的市场价格约为30k-32k美元。SXM卡并不是真正作为单张卡出售的,因此很难在那里给出定价。通常作为4-GPU和8-GPU服务器出售。大约70-80%的需求是SXMH100,其余的是PCIeH100。SXM部分的需求呈上升趋势,因为PCIe卡是前几个月***可用的卡。鉴于大多数公司购买8-GPUHGXH100(SXM),每360个H380的大约支出为8k-100k,包括其他服务器组件。DGXGH200(提醒一下,包含256xGH200,每个GH200包含1xH100GPU和1xGraceCPU)的成本可能在15mm-25mm之间-尽管这是一个猜测,而不是基于定价表。19需要多少个GPU?#GPT-4可能在10,000到25,000架A100之间接受过训练。20Meta拥有大约21,000架A100,特斯拉拥有约7,000架A100,稳定AI拥有约5,000架A100。21猎鹰-40B在384架A100上进行了训练。22Inflection使用3,500H100作为其。23顺便说一句,到22月,我们有3k在运行。并且***运行超过5.<>k。——穆斯塔法·苏莱曼(MustafaSuleyman)。H100 GPU 特价销售,赶快抢购。HBMH100GPU多少钱一台

H100 GPU 的高性能计算能力为此类任务提供了极大支持。重庆H100GPU stock

提供了1exaFLOP的FP8稀疏AI计算性能。同时支持无线带宽(InifiniBand,IB)和NVLINKSwitch网络选项。HGXH100通过NVLink和NVSwitch提供的高速互连,HGXH100将多个H100结合起来,使其能创建世界上强大的可扩展服务器。HGXH100可作为服务器构建模块,以集成底板的形式在4个或8个H100GPU配置中使用。H100CNXConvergedAcceleratorNVIDIAH100CNX将NVIDIAH100GPU的强大功能与NVIDIA®ConnectX-7SmartNIC的**组网能力相结合,可提供高达400Gb/s的带宽包括NVIDIAASAP2(加速交换和分组处理)等创新功能,以及用于TLS/IPsec/MACsec加密/的在线硬件加速。这种独特的架构为GPU驱动的I/O密集型工作负载提供了前所未有的性能,如在企业数据中心进行分布式AI训练,或在边缘进行5G信号处理等。H100GPU架构细节异步GPUH100扩展了A100在所有地址空间的全局共享异步传输,并增加了对张量内存访问模式的支持。它使应用程序能够构建端到端的异步管道,将数据移入和移出芯片,完全重叠和隐藏带有计算的数据移动。CUDA线程只需要少量的CUDA线程来管理H100的全部内存带宽其他大多数CUDA线程可以专注于通用计算,例如新一代TensorCores的预处理和后处理数据。扩展了层次结构。重庆H100GPU stock